RecursiveMAS:多智能体推理提速2.4倍,token消耗锐减75%

多智能体系统的核心挑战

当前多智能体AI系统的关键瓶颈在于,智能体间依赖文本序列进行通信。这种通信方式不仅导致延迟增加、token成本飙升,还使得整个系统的协同训练变得异常困难——各智能体如同独立个体,难以形成统一的协作机制。

尽管多智能体系统能处理单智能体难以应对的复杂任务,但在实际应用中,如何让系统持续进化、适应不同场景仍是难题。基于提示的适应方法通过迭代优化共享上下文来改善智能体交互,但底层模型的静态能力限制了其潜力;而通过更新模型权重进行训练的方式,又因多模型参数同步更新的计算复杂度而难以实现。

更严重的是,传统文本通信模式形成了重大瓶颈:智能体需按顺序生成文本,导致每个模型必须等待前序模型完成处理才能开始工作,延迟显著。此外,强制模型逐token输出中间推理过程以供后续模型读取,既低效又浪费token,大幅推高计算成本,使系统级迭代学习难以扩展。

RecursiveMAS的突破性设计

为解决上述问题,伊利诺伊大学厄巴纳-香槟分校与斯坦福大学的研究者提出了RecursiveMAS框架。该框架的核心创新在于,让智能体通过嵌入空间而非文本进行协作,从而实现效率与性能的双重提升。

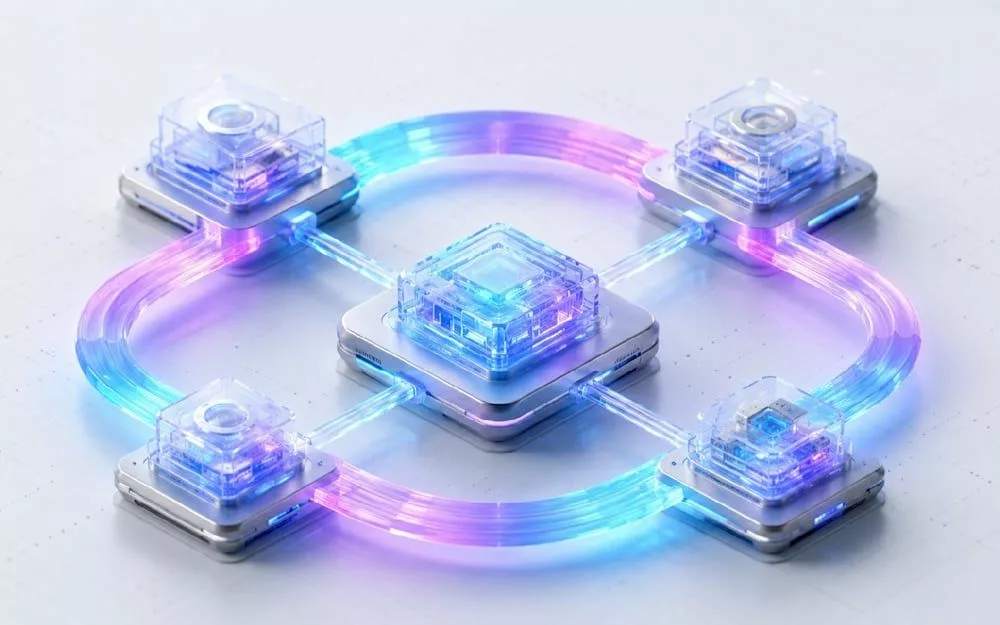

RecursiveMAS借鉴了递归语言模型(RLMs)的思想:在传统语言模型中,数据线性流经独立层;而递归语言模型则通过复用共享层并循环计算,实现更深推理而不增加参数。RecursiveMAS将这一原理扩展至多智能体架构,使每个智能体如同递归模型中的一层,通过传递连续的潜在表示(latent representations)而非文本,形成循环信息流。

具体而言,智能体间迭代传递潜在表示,最终输出由末尾智能体生成文本。这种结构让整个系统在潜在空间中完成交互、反思与推理优化,仅在最后阶段输出文本——如同智能体间实现“心有灵犀”的隐式通信。

潜在协作的架构实现

RecursiveMAS的核心组件是RecursiveLink模块,这是一个轻量级双层数据结构,专为传输和优化模型潜在状态而设计,而非强制解码为文本。语言模型的最后一层隐藏状态包含了推理过程的丰富语义表示,RecursiveLink旨在保留并传递这些高维信息。

为避免更新多模型参数的高昂成本,框架冻结了各智能体的基础模型参数,仅训练RecursiveLink模块。该模块分为内层与外层:内层RecursiveLink在智能体内部运行,将新生成的嵌入直接映射回自身输入空间,使智能体持续生成潜在思维流;外层RecursiveLink则作为智能体间的桥梁,通过额外层匹配不同智能体的嵌入维度(因现实系统中智能体可能采用不同架构)。

训练分为两步:先独立训练内层RecursiveLink,预热智能体在潜在嵌入中的推理能力;再进入外层循环训练,将冻结的多样化模型串联成循环,仅根据末尾智能体的文本输出评估系统,更新RecursiveLink参数。这种策略类似LoRA方法,且当多个智能体共享同一基础模型时,无需重复加载模型或单独训练,显著节省资源。

实验验证与性能表现

研究者在数学、科学、医学、代码生成及搜索问答等九大基准测试中验证了RecursiveMAS。他们使用Qwen、Llama-3、Gemma3、Mistral等开源模型构建多智能体系统,分配不同角色形成顺序推理或混合专家协作模式,并与LoRA微调、全监督微调、Mixture-of-Agents、TextGrad及LoopLM等基线方法对比。

结果显示,RecursiveMAS在保持精度的同时,推理速度提升2.4倍,token消耗减少75%,训练成本远低于传统方法,为定制化多智能体系统提供了可扩展、高性价比的蓝图。

关注微信号:智享开源 ,可及时获取信息

关注微信

关注微信

还没有任何评论,你来说两句吧!